近日,2020年国际人工智能联合会议(International Joint Conference on Artificial Intelligence,简称“IJCAI”)公布了论文录用结果,我院信息学部有七篇论文入选,分别为 “基于单目视觉的深度估计、视觉里程计以及相机重定位任务的联合学习算法”(Collaborative Learning of Depth Estimation, Visual Odometry and Camera Relocalization from Monocular Videos,作者:2017级硕士生赵海媚,导师:袁博) “一种用于点击率预测的双输入感知因式分解机模型”(A Dual Input-aware Factorization Machine for CTR Prediction,作者:2018级硕士生路万通,导师:袁博);“低成本无监督领域自适应一步式解决方法”(Clarinet: A One-step Approach Towards Budget-friendly Unsupervised Domain Adaptation,作者:2018级硕士生张艺杨,导师:袁博);“基于特征增强的记忆模块与注意力机制在视频问答中的应用”(Feature Augmented Memory with Global Attention Network for VideoQA,作者:2018级硕士生蔡佳音,导师:袁春);“HAF-SVG:基于特征对齐的层次化随机视频生成”(HAF-SVG: Hierarchical Stochastic Video Generation with Aligned Features,作者:2014级博士林智慧,导师:袁春);“基于锚定原型的三元组到文本生成”(Triple-to-Text Generation with an Anchor-to-Prototype Framework,作者:2018级硕士生李自然、林子博,导师:郑海涛);“基于特征增强的记忆模块与注意力机制在视频问答中的应用基于树状规划注意力神经网络的表格到文本生成”(Infobox-to-text Generation with Tree-like Planning based Attention Network,作者:2018级硕士生柏杨,导师:郑海涛)。

图(从左至右,自上而下)为赵海媚、路万通、张艺扬、蔡佳音、林智慧、李自然、林子博、柏杨

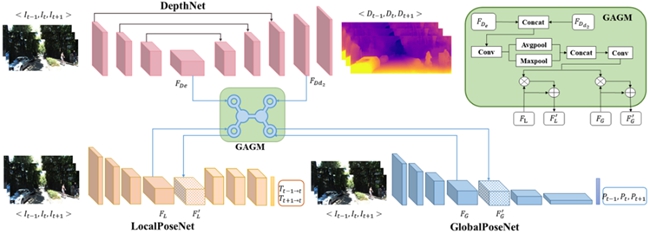

近年来,由于自动驾驶、机器人以及无人机等无人系统应用的迅速发展,通过单目视觉对周围环境进行感知和定位的研究得到了广泛的关注,如深度估计、视觉里程计以及相机重定位等基础任务。以往的方法通常对这些感知和定位任务进行单独研究,而忽略了它们之间的几何相关性。赵海媚同学在论文中提出了一个联合学习框架,利用三个网络分支(DepthNet,LocalPoseNet 和 GlobalPoseNet) 分别从不同的角度感知环境,同时完成深度估计、视觉里程计和相机重定位三个任务。通过有针对性地设计联合优化损失,三个分支能够在学习期间提供互补的优势并克服单个任务学习中的缺陷。另外,在框架中引入了几何注意指导模型 GAGM,可从深度估计分支中提取有价值的三维几何信息,以帮助视觉里程计和相机重新定位任务的估计,反之也进一步提高深度估计的精度。论文中详尽的定量及定性实验结果展示出了通过联合学习同时提高三个任务的性能的巨大前景。

图为联合学习框架网络结构图

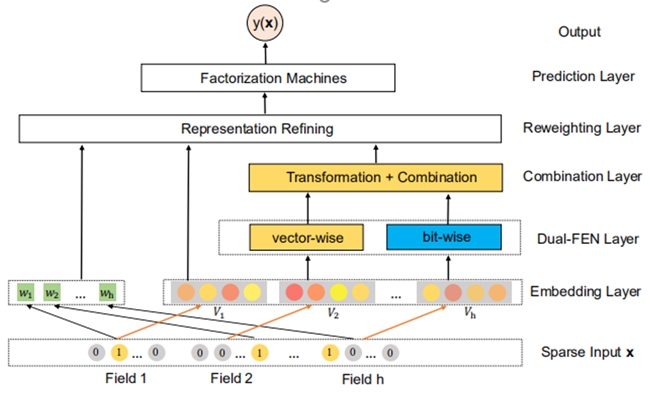

因子分解机(FM)是一类能够用于任何实值特征向量的通用预测器,众所周知,它在数据极度稀疏的场景下(如CTR预测)能够很好地估计模型的参数。但是,在标准FM中,同一个特征在不同的输入实例中生成单个固定的表示形式,这可能会限制CTR模型的表达能力和预测能力。受到输入感知因数分解机(IFM)成功的启发,该方法旨在根据不同的输入实例来学习给定特征的更灵活、信息量更大的表示形式。路万通同学提出了一种新颖的模型,称为双重输入感知因数分解机(DIFM),同时在位和矢量级别来学习输入感知因子,并用于自适应地重新加权原始特征表示。此外,DIFM将包括Multi-Head Self-Attention、残差网络和DNN在内的各种组件策略性地集成到统一的“端到端模型”中。在两个实际CTR预测数据集上的综合实验表明,DIFM模型可以始终胜过多个最新模型。

图为DIFM模型的整体结构图

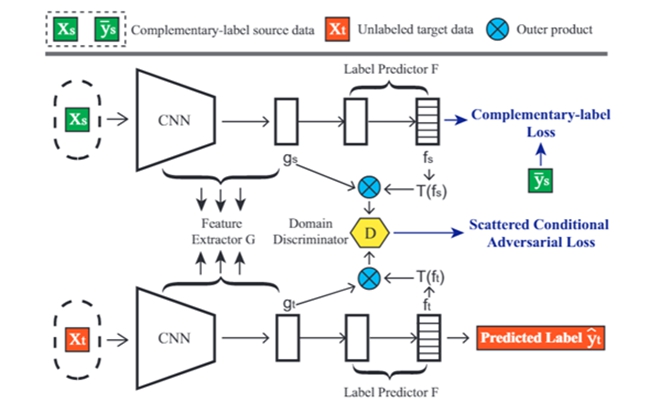

无监督领域自适应(UDA)是一种针对解决源域和目标域分布差异的机器学习算法,旨在通过学习源域和目标域的域不变特征,从而在目标域没有标签的情况下,将从有标签的源域中学到的分类器应用于目标域。但是在成本有限的情况下,收集足够多的源域标记样本也是很难实现的。张艺扬同学考虑了一种新的低成本域适应情况,使用带有补充标签的源域进行知识迁移(BFUDA)并搭建有效解决BFUDA问题的对抗模型CLARINET,相对于真实标签,为样本标记补充标签要简单和低廉很多,可以帮助迁移学习进一步推广应用。实验证明CLARINET可以有效地利用携带补充标签的源域实现知识迁移。

图为CLARINET核心框架

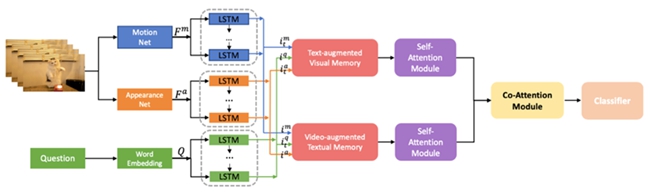

在视频理解领域,基于递归神经网络(RNN)的方法和基于自注意力机制的方法均取得了不错的成果。传统的基于RNN模型(LSTM)学习到的长期依赖关系很有限,当网络层数比较多时,越后面的隐状态区分度越低,会出现饱和的现象,导致无法精确记录一段视频或者语句中很久之前的内容,造成记忆信息量不足。而基于自注意力机制的方法虽然能直接关联长距离帧之前的信息,但是对时序的建模能力较弱。为了解决这些问题,蔡佳音同学提出一种跨模态的特征增强记忆模块,把需要记忆的重要信息写入长时记忆组件、从中读出加以利用,并且用自注意力机制与跨模态注意力机制对视觉和文本的全局高级语义信息进行交互。

图为模型总体框架

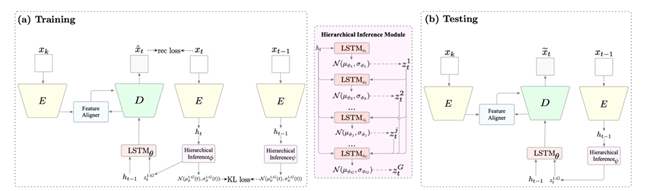

视频生成(Video Generation)是一项极具挑战性的任务,而未来往往具有不确定性。随机视频生成(SVG)为了对不确定性建模以及生成多样的未来,使用基于变分推断自编码器(VAE)的方法,而这类方法往往会由于帧间的表征非对齐性而导致生成的视频帧发生表征崩溃、物体发生畸变的现象。为了能对未来不确定性进行更加细致的建模和理解,以及解决物体表征崩溃问题,林智慧同学提出了特征对齐的层次化随机视频生成方法(HAF-SVG)。在多个合成以及真实数据集中进行了验证,HAF-SVG在质量和数量指标上都明显优于之前最好的方法。同时,可视化的样例也表明层次化模型可以提取出具有解纠缠(Disentanglement)性质的视频表征,这可以帮助我们更好地理解视频信息和分析出关键的生成因子。

图为haf-svg流程图

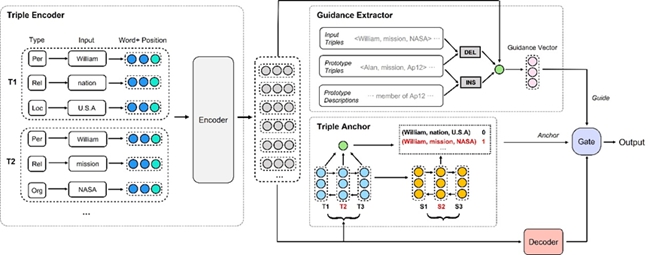

在自然语言生成中,给定一组实体关系三元组生成一段对应的描述文本是一项具有挑战性的任务。目前基于神经网络的序列到序列模型已经成为这项任务的主流方法,这些方法通常直接基于输入从头开始生成目标句子。然而,由于结构化输入和非结构化输出之间数据结构的巨大差异,单凭输入中的三元组不足以生成一段表达正确且具体的文本。李自然和林子博同学在论文中提出了一个名为锚定原型(Anchor-to-Prototype)的全新框架,来填补三元组集合与自然文本之间的结构化差异。该框架在训练数据中检索相似的三元组集合及其对应的描述文本,并从中提取写作模板来指导当前输入的文本生成。同时,为了更精确地利用检索到的写作模板,该框架进一步将输入的三元组按句子进行分组和对齐,从而更好地匹配模板。

图为锚定原型框架图

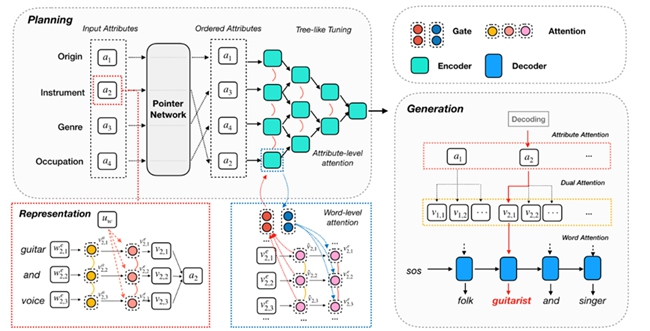

柏杨同学的论文针对从结构化数据自动生成文本描述的任务,提出了对输入信息进行先初步排序后动态调整的规划方法来解决现有的顺序规划和文本生成阶段之间的错误传递问题。论文提出了一个基于树状规划的注意力神经网络,通过对多头自注意力引入树状结构来引导编码器对输入信息进行逐层微调与整合,以得到更好的规划来指导文本生成。实验结果表明该方法可以有效提高文本生成的质量,同时提高模型对乱序输入的适应性。

图为基于树状规划的注意力神经网络

国际人工智能联合会议在国内外颇具影响力,在今年的4717 份有效投稿中,最终仅有 592 篇被接收。

图、文:袁博、袁春、郑海涛、黄凌燕

绘图:吴宇涛

绘图指导:温雪媛

编辑:柴头