深度信息感知在智能制造、三维重建、自动驾驶等领域中发挥着至关重要的作用,先进的深度估计网络需要在精度、鲁棒性、计算复杂度等方面取得较好的性能与平衡。然而,对于挥发窑等复杂的工业场景,现有的单目深度估计网络仍面临着深度估计精度低、鲁棒性不佳等挑战。因此,如何设计高精度、高鲁棒性的单目深度估计网络,准确重建挥发窑物料的深度模型,进而为温度场模型的构建、优化燃料控制提供支持,并助力实现碳达标、碳中和的目标已成为亟待解决的关键问题。

近日,清华大学深圳国际研究生院副教授李星辉团队与鹏城实验室团队合作提出了一种名为“Attention Mono-depth”的单目深度估计网络。该网络通过对包含上下文语义信息的多级特征图进行注意力机制的引导,采用分类的策略自适应划分深度区间,解决火焰干扰下误差一致性偏离的问题,具有单目深度估计精度高、对于不同燃烧状态的深度估计鲁棒性强、网络计算复杂度低、易于部署等优势。同时,团队搭建的挥发窑模型能够模拟真实工业现场的物料运动状态,并具备精确调控下料量、转速等参数的特点。

图1 单目深度估计网络架构

图2 搭建的挥发窑模型

受到注意力机制的启发,研究提出“注意力特征融合”模块 (Attentional feature fusion block) 对具有不同深度信息的多尺度特征图进行有效融合,得到语义先验信息引导的深度特征,以此进行深度区间的精确划分。该模块结合全局注意力机制与局部注意力机制,共同考虑长距离像素间的关系以及图像的局部细粒度特征,更有效地利用多尺度深度特征进行深度区间的自适应划分,解决深度不连续的问题,提高单目深度估计的精度。

图3 Attentional feature fusion block结构

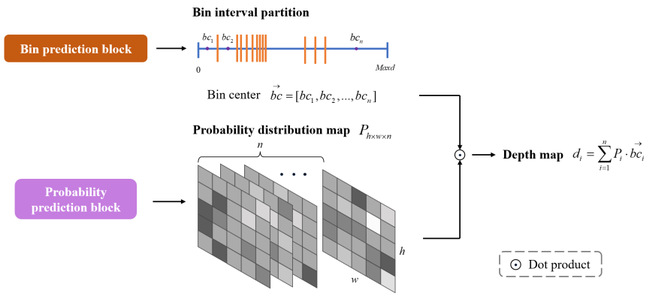

此外,研究提出“深度生成模块” (Depth generation module),将单目深度估计视作分类任务,对图像中各个像素点所在的深度区间进行自适应划分,解耦了整幅图像像素间的一致性关系,避免图像由于受到火焰干扰而产生误差一致性偏离的问题,增强了算法的鲁棒性。该模块以自适应划分的深度区间和最高分辨率的解码器特征图作为输入,通过“概率预测模块”(Probability prediction block) 生成预测的各像素点的概率分布。因此深度区间的中心值向量与图像上各像素落在对应深度区间的概率分布的点积和为最终预测的深度图。

图4 Depth generation module结构

研究探讨了深度区间划分数量、特征图多级融合方式、特征融合模块架构、编码器的选择等重要网络参数对深度估计精度的影响,并分别在有无火焰数据的物料数据集上进行实验验证,结果表明研究提出方法的深度估计结果显著优于传统的散焦测距方法,且相较于最先进的单目深度估计网络,其在各项深度评价指标中均为最佳。

表1 对比实验结果

相关研究成果以“Attention Mono-depth: 基于注意力机制-Transformer架构的挥发窑料面单目深度估计”(Attention Mono-depth: attention-enhanced transformer for monocular depth estimation of volatile kiln burden surface) 为题,发表在“工程:电子与电气”领域、中科院一区期刊《IEEE电路与系统视频技术汇刊》(IEEE Transactions on Circuits and Systems for Video Technology, TCSVT)。

论文第一作者为清华大学深圳国际研究生院2022级硕士生刘聪,李星辉为通讯作者,鹏城实验室张超波助理研究员为共同通讯作者,论文的共同作者包括鹏城实验室梁骁俊副研究员,清华大学深圳国际研究生院2021级博士生韩智明、李一鸣,中南大学阳春华教授、桂卫华院士,鹏城实验室高文院士,清华大学深圳国际研究生院王晓浩研究员。该研究工作得到了清华大学深圳国际研究生院交叉基金、鹏城实验室重大攻关项目、国家自然科学基金等支持。

论文链接:https://doi.org/10.1109/TCSVT.2024.3479412.

文/图:刘聪、李星辉

编辑:叶思佳

封面设计:刘雨嘉

审核:陈超群